12月15日消息,在人工智能大模型浪潮的推动下,AI训练数据集正极速扩增。以ChatGPT为例,去年11月发布的GPT-3,使用1750亿个参数构建,今年3月发布的GPT-4使用超过1.5万亿个参数。海量的数据训练,这对算力提出了高需求。

而HBM(高频宽存储器)作为内存的一种技术类型,采用创新的2.5D/3D架构,能够为AI加速器提供具有高内存带宽和低功耗的解决方案,同时凭借极低的延迟和紧凑的封装,HBM已成为AI训练硬件的首选。

TrendForce预估,2024年全球HBM的位元供给有望增长105%;HBM市场规模也有望于2024年达89亿美元,同比增长127%;预计2025年HBM市场规模将会突破100亿美元。

近日,作为业界领先的芯片和IP核供应商, Rambus Inc.(纳斯达克股票代码:RMBS)宣布Rambus HBM3内存控制器IP现在可提供高达9.6 Gbps的性能,可支持HBM3标准的持续演进。

大幅提升AI性能 提供领先支持

众所周知,JEDEC(电子工程器件联合委员会)将DRAM分为标准DDR、移动DDR以及图形DDR三类,HBM则属于图形DDR中的一种。

在设计上,HBM包含了中介层,以及处理器、内存堆栈。HBM通过使用先进的封装方法(如TSV硅通孔技术)垂直堆叠多个DRAM,与GPU通过中介层互联封装在一起,打破了内存带宽及功耗瓶。这也让传输速率成为了HBM的核心参数。

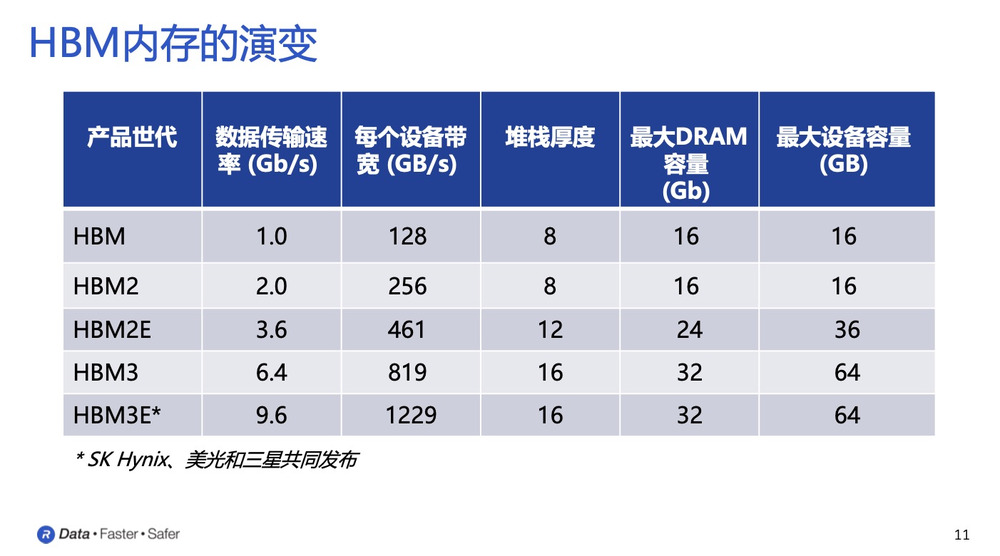

从2014年全球首款HBM产品问世至今,HBM技术已发展至第四代,分别为HBM、HBM2、HBM2e、HBM3,带宽和容量分别从最初128GB/S和1GB提升至819GB/S和24GB,传输速度从1Gbps提高至6.4Gbps。据悉,第五代HBM3E已在路上, 由SK Hynix、美光和三星共同发布,它所支持的数据传输速率达到9.6Gb/s。

对于HBM而言,Rambus并不陌生,早于2016年就入局了HBM市场。此次发布的Rambus HBM3内存控制器IP专为需要高内存吞吐量、低延迟和完全可编程性应用而设计。相比HBM3 Gen1 6.4 Gbps 的数据速率,Rambus HBM3内存控制器的数据速率提高了50%,总内存吞吐量超过1.2 TB/s,适用于推荐系统的训练、生成式AI以及其他要求苛刻的数据中心工作负载。

Rambus 接口IP产品管理和营销副总裁 Joe Salvador介绍称,该控制器是一种高度可配置的模块化解决方案,可根据每个客户对尺寸和性能的独特要求进行定制。目前已与SK海力士、美光、三星完成了一整套的测试。对于选择第三方HBM3 PHY(物理层)的客户,Rambus还提供HBM3控制器的集成与验证服务。

就当前HBM市场发展格局,Joe Salvador坦言道:“目前为止还没有了解到有哪一家竞争对手跟我们一样,已经有经过验证的能够去支持HBM3 9.6Gbps传输速率的内存控制器IP。Rambus HBM3内存控制器将以高达9.6Gb/s的性能,为HBM3提供业界领先的支持。”

同时,Joe Salvador表示,一家企业想进入到HBM行业会面临相应的一些门槛和有诸多的挑战,首先就是对于总体架构设计的复杂度和了解程度不够。Rambus正是得益于积累了多年的技术经验和跟主流内存厂商合作的经验,使得所设计出来的内存控制器可以做到高性能、低功耗,而且对于客户来说成本也相对较低,且具有很好的兼容性。

AI时代 Rambus将全面发力

当前大模型的百花齐放,让HBM也水涨船高。

文章内容仅供阅读,不构成投资建议,请谨慎对待。投资者据此操作,风险自担。

奥维云网(AVC)推总数据显示,2024年1-9月明火炊具线上零售额94.2亿元,同比增加3.1%,其中抖音渠道表现优异,同比有14%的涨幅,传统电商略有下滑,同比降低2.3%。

“以前都要去窗口办,一套流程下来都要半个月了,现在方便多了!”打开“重庆公积金”微信小程序,按照提示流程提交相关材料,仅几秒钟,重庆市民曾某的账户就打进了21600元。

华硕ProArt创艺27 Pro PA279CRV显示器,凭借其优秀的性能配置和精准的色彩呈现能力,为您的创作工作带来实质性的帮助,双十一期间低至2799元,性价比很高,简直是创作者们的首选。